Tabla de contenido:

- Autor John Day day@howwhatproduce.com.

- Public 2024-01-30 08:43.

- Última modificación 2025-01-23 14:40.

En este artículo, explicaremos el significado del procesamiento de imágenes digitales (DIP) y las razones para usar hardware como Pixy y otras herramientas para realizar un proceso en imágenes o videos. Al final de este artículo, aprenderá:

- Cómo se forma una imagen digital.

- Qué es el procesamiento de imágenes digitales.

- Herramientas para procesamiento de imágenes.

- Qué es Pixy y cómo usarlo.

Paso 1: ¿Qué es el procesamiento de imágenes?

Las fotos, los videos y en general las imágenes además de guardar un momento de nuestros recuerdos, también tienen otras aplicaciones. Tal vez vea cámaras de seguridad en lugares públicos o vea robots rastreando una línea, objeto o más avanzado dándose cuenta de la situación, separando las impurezas de los productos en la línea de producción y muchas aplicaciones similares o incluso no similares están haciendo con algunos cálculos en imágenes y estos los cálculos se denominan procesamiento de imágenes.

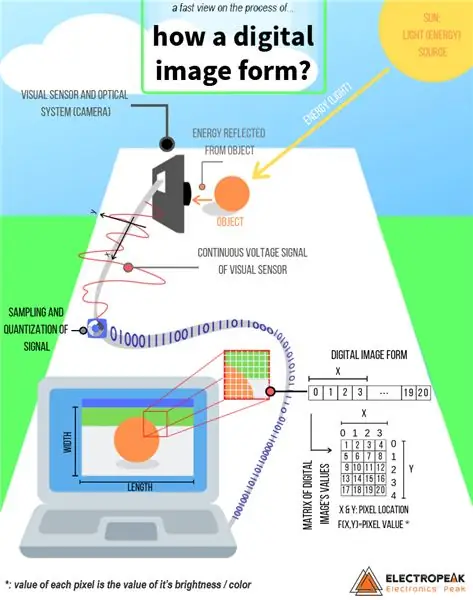

Para una mejor comprensión, es útil conocer la estructura de la imagen. Cada imagen es una señal con los valores de píxeles en cualquier punto de eso. (el píxel es la unidad básica de una imagen digital que puede tener diferentes valores para su brillo y / o color, estos valores se denominan “intensidad”) La señal es la señal de voltaje continuo dada por el sensor visual, esta señal se convertirá a digital forma con algunos procesos como el muestreo. La forma digital de estos datos es como una matriz o matriz bidimensional que crea una imagen digital, por lo que su forma es f (X, Y) para la ubicación y el valor. No olvide que cada video es un conjunto de imágenes que se reproducen con una velocidad de reproducción específica en un segundo.

Después de formar una imagen, comenzará el proceso. ¿Para qué necesitamos un proceso? Si necesitamos información de una imagen, usaremos la visión por computadora. La visión por computadora es una forma de emular la visión humana. La visión humana tiene la capacidad de "aprender" y dar datos a partir de entradas visuales. Básicamente, la visión por computadora es el campo que hizo que la computadora obtenga una comprensión de alto nivel a partir de imágenes o videos digitales, incluso para usos en tiempo real; y el procesamiento de imágenes digitales es parte de eso.

Paso 2: ¿Cómo procesar imágenes?

Si estamos pensando en una aplicación robótica para el procesamiento de imágenes, existen dos formas:

- eligiendo un módulo de cámara habitual (proporcionando la imagen sin ningún procesamiento) y luego usando programación y cálculos por parte del usuario.

- Usar productos duros que realicen este proceso para un uso más rápido y fácil; Como una cámara pixy …

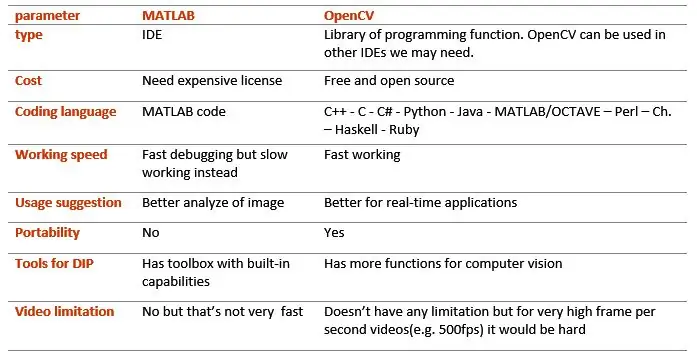

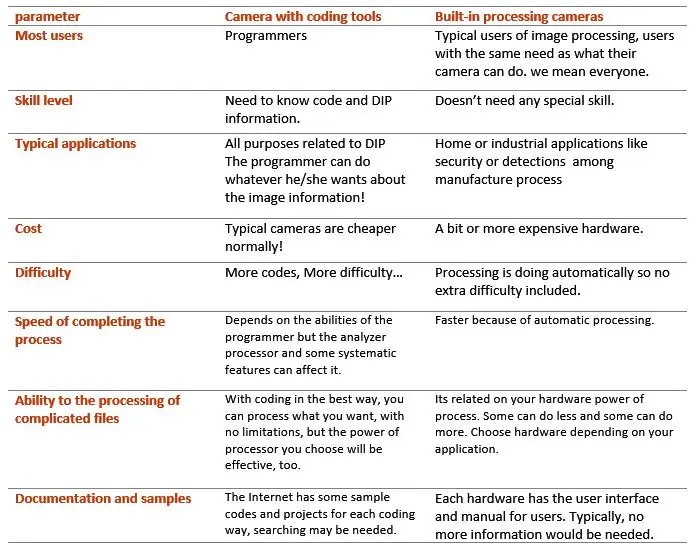

Primera solución: por primera vez, existen diferentes software como MATLAB o bibliotecas como OpenCV para la codificación. También hay otros nombres en las herramientas de procesamiento; pero los nombres populares que buscan este procesamiento son OpenCV y MATLAB. Veamos una comparación rápida entre ellos. la tabla de comparación de MATLAB y OpenCV nos ayudará.

Segunda solución: ¡usar un hardware especial! como cámaras con capacidad de procesamiento de imágenes. Por lo general, tienen una interfaz de usuario y no necesitan codificación. Eso parece más fácil, pero de alguna manera crea limitaciones y pueden hacer lo que se les especifique para eso; por ejemplo, una cámara de detección de rostros no puede realizar el reconocimiento de color normalmente (tal vez con algunos cambios en el firmware se puede cambiar el algoritmo de reconocimiento, ¡pero esa es una manera difícil y no común!) De dos maneras, pero ¿cuál es mejor?

el segundo gráfico es la comparación de dos formas.

Paso 3: Primeros pasos con Pixy

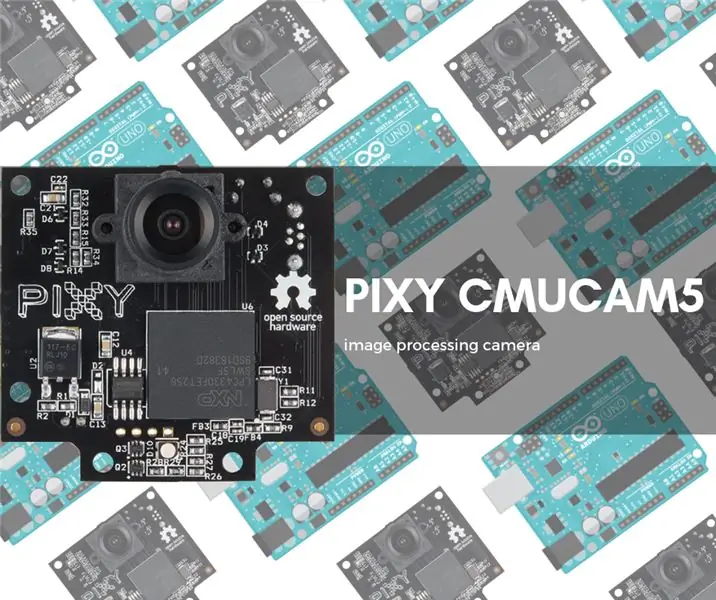

PIXY es uno de los módulos de cámara especificados para el procesamiento de imágenes, el algoritmo de reconocimiento es un filtrado basado en colores. El objetivo principal de esta cámara es reconocer los colores y nombrarlos como un objeto familiar. Esta cámara puede "aprender" qué colores "pensaste" al principio.

Ahora que sabe qué es Pixy, veamos cómo podemos empezar a utilizar Pixy.

Paso 4: Hardware necesario

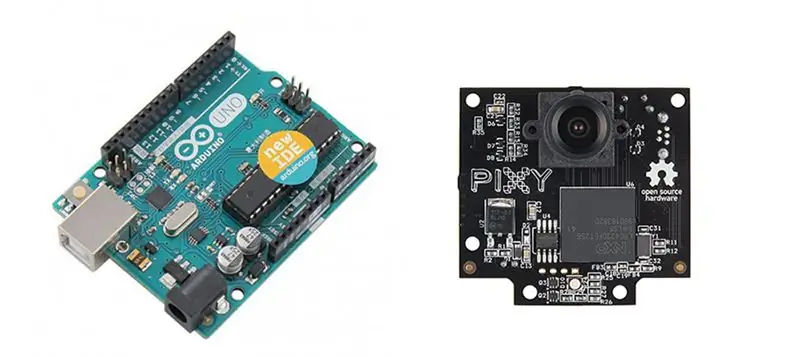

Sensor de imagen Pixy CMUcam5

Arduino UNO R3

Paso 5: Primeros pasos con Pixy

Ahora ven con nosotros paso a paso hasta el final:

Primer paso:

¡Comprando un pixy! Regular PIXY y PIXY2 son dos versiones de cámaras pixy. haga clic en el enlace de arriba para comprar el tipo regular, que continuamos con los pasos del uso de esta placa.

Segundo:

Enciendelo. La placa tiene un puerto USB para alimentación. Se alimentará conectándose al puerto USB de la computadora. Se puede alimentar a través de dos pines detrás de la placa con batería (6-10v).

Tercera:

Conéctelo a la computadora mediante un cable USB. Un extremo al ordenador y otro al puerto micro USB de PIXY.

Adelante:

Descarga el software de tu cámara aquí. PIXY Mon es la aplicación de PIXY para plataformas Linux, Mac y Windows. Lo que esta aplicación puede hacer es configurar y mostrar lo que PIXY puede ver.

Quinto:

Hasta este punto, la cámara no necesita estar conectada necesariamente a un microcontrolador o placa si necesita ver y reconocer sin nada más; el reconocimiento no depende de la micro conexión. De todos modos, para enseñar, seleccione un objeto con un tono distinto y bueno. Debido al algoritmo de reconocimiento de filtrado de color basado en tonos, el tono y la luz del entorno pueden afectar el resultado. Por lo tanto, no elija objetos blancos, negros o grises porque estos colores no son matices.

Sexto:

Presione el botón en la parte superior de PIXY para comenzar a enseñar. Primero, el LED parpadeará y luego, un LED RGB obtendrá el color de la parte central del área de visión. Elija el objeto frente a la cámara, si el LED mostró el color correcto, muestra el bloqueo correcto. la distancia entre las lentes y el objeto debe ser de 6 a 20 pulgadas. La segunda forma es usando PIXY MON; eligió un área grande del objeto en PIXY MON y luego selecciona el objeto.

Séptimo:

La cuadrícula del objeto se mostrará en pixy mon. vea si la cuadrícula es el área correcta del objeto sin incluir el fondo. Los controles deslizantes en la configuración pueden ayudar a tener un área mejor.

Octavo:

Ahora, para cada "color", la cámara establecerá un número. 7 firmas significan 7 colores para reconocer. Con el uso de colores cercanos entre sí, por ejemplo, una etiqueta con los colores rojo-rosa-azul, puede definir un objeto o lugar para la cámara, por ejemplo, esa etiqueta muestra el lugar de la puerta. ¡Esto puede ayudar a reconocer miles de objetos con esta cámara! Este conjunto de colores se denomina "código de color" o CC. para configurar CC, debe usar PIXY mon y luego se puede usar como cualquier firma.

Noveno:

Después de una enseñanza exitosa, si un microcontrolador o placa está conectado a la cámara, puede dar el objeto detectado por pixy. Si está utilizando un Arduino, utilice este pinout para la conexión. (haga clic aquí para obtener más información), luego descargue la biblioteca PIXY aquí, agréguela a las bibliotecas de Arduino en la dirección de Sketch> Incluir biblioteca> Agregar biblioteca ZIP. Ahora seleccione el archivo zip de la biblioteca. ¡Eso está hecho! Ahora, con el boceto predeterminado de PIXY, dará la X e Y (ubicación) y el ancho y largo (tamaño) del objeto. También se pueden utilizar otros bocetos; como pan y tilt. Para la conexión de otras placas, puede ver aquí.

NOTA: La enseñanza tiene dos métodos, como explicamos: 1. Usar PIXY sin PIXY MON, como lo que hacen los robots y no están conectados a una PC. El método será, pero ¿cómo configurar el número de firma? El led si el PIXY cambiará de color en los primeros momentos de enseñanza, el clic que hagas sobre qué color establecerá el número; del rojo que significa 1 al violeta que significa 7. En el método 2, la configuración del número se realizará solo con la aplicación.

Paso 6: Muy cerca de "EL FINAL"

Explicamos qué motivó el uso de imágenes, qué es el procesamiento de imágenes digitales y cómo se puede hacer. De qué formas tenemos y del hardware que actualmente puede ayudarnos, elegimos PIXY para la explicación. ¡Te explicamos cómo funciona y qué hacer si eres un principiante de las cámaras pixy! Ahora puede iniciar el procesamiento de imágenes para su pequeño robot y disfrutar de tener un tercer ojo con su computadora.

También puede leer este proyecto en el sitio web oficial de ElectroPeak:

Recomendado:

Sistema de extinción y reconocimiento de incendios basado en procesamiento de imágenes: 3 pasos

Sistema de extinción y reconocimiento de incendios basado en procesamiento de imágenes: Hola amigos, este es un sistema de extinción y detección de incendios basado en procesamiento de imágenes que utiliza Arduino

Procesamiento de imágenes con Raspberry Pi: instalación de OpenCV y separación de color de imagen: 4 pasos

Procesamiento de imágenes con Raspberry Pi: instalación de OpenCV y separación de color de imágenes: esta publicación es la primera de varios tutoriales de procesamiento de imágenes que se seguirán. Echamos un vistazo más de cerca a los píxeles que componen una imagen, aprendemos cómo instalar OpenCV en la Raspberry Pi y también escribimos scripts de prueba para capturar una imagen y también c

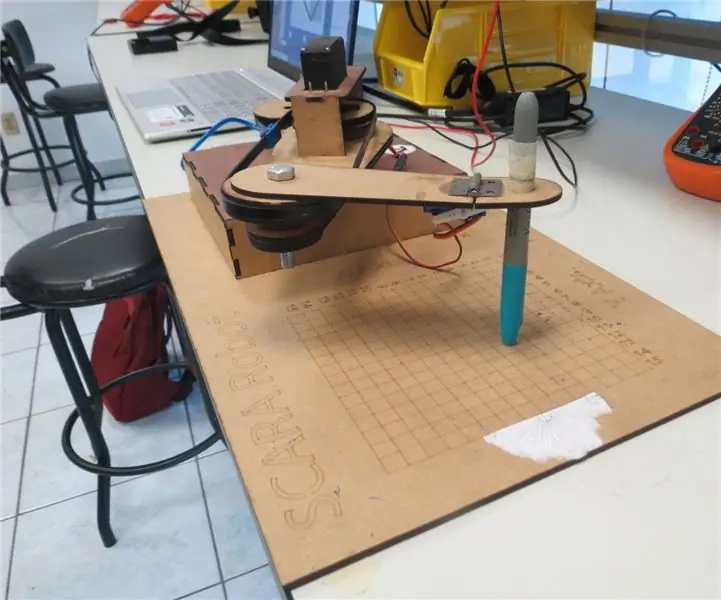

Robot SCARA: ¡Aprendiendo sobre cinemática inversa e inversa! (Plot Twist Aprenda a hacer una interfaz en tiempo real en ARDUINO usando PROCESAMIENTO !!!!): 5 pasos (con imágenes)

Robot SCARA: ¡Aprendiendo sobre cinemática inversa e inversa! (Plot Twist Aprenda a hacer una interfaz en tiempo real en ARDUINO usando PROCESAMIENTO !!!!): Un robot SCARA es una máquina muy popular en el mundo de la industria. El nombre significa Brazo robótico de ensamblaje compatible selectivo o Brazo robótico articulado compatible selectivo. Básicamente es un robot de tres grados de libertad, siendo los dos primeros visualiz

Gesture Hawk: Robot controlado por gestos con la mano utilizando una interfaz basada en procesamiento de imágenes: 13 pasos (con imágenes)

Gesture Hawk: robot controlado por gestos con la mano que utiliza una interfaz basada en procesamiento de imágenes: Gesture Hawk se presentó en TechEvince 4.0 como una sencilla interfaz hombre-máquina basada en el procesamiento de imágenes. Su utilidad radica en el hecho de que no se requieren sensores adicionales o wearables excepto un guante para controlar el automóvil robótico que funciona en diferentes

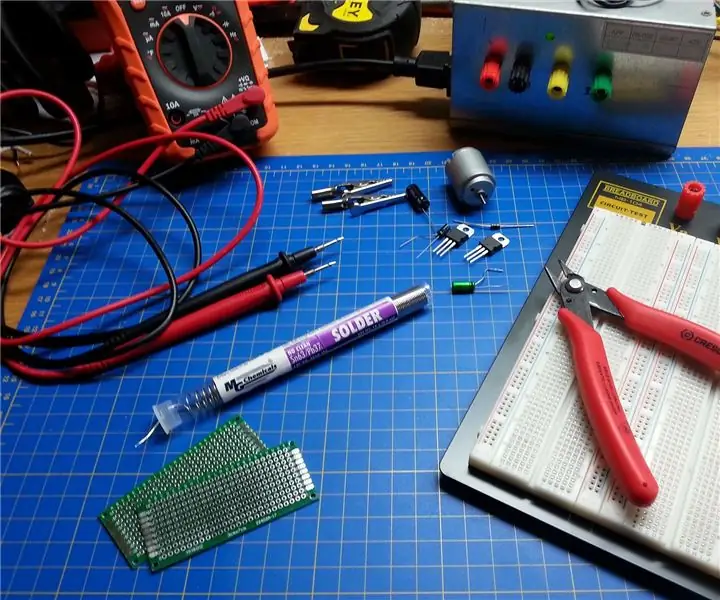

10 alternativas de bricolaje a los componentes electrónicos disponibles en el mercado: 11 pasos (con imágenes)

10 alternativas de bricolaje a los componentes electrónicos disponibles en el mercado: ¡Bienvenido a mi primer instructivo! ¿Siente que ciertas partes de los minoristas en línea son demasiado caras o de baja calidad? Necesita tener un prototipo listo y funcionando rápidamente y no puedo esperar semanas para el envío? ¿No hay distribuidores locales de productos electrónicos?